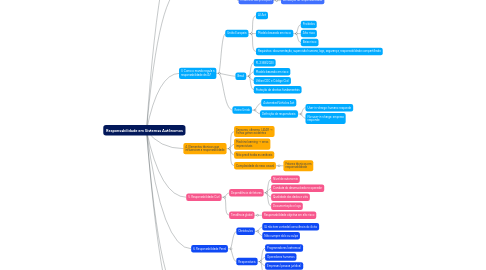

1. 1. O que é responsabilidade em sistemas autônomos?

1.1. Aplicação de regras

1.1.1. Responsabilidade civil e penal para IA

1.2. Desafio central

1.2.1. IA não age com vontade humana

1.2.2. Causa danos reais

1.3. Solução adotada

1.3.1. Responsabilidade atribuída a humanos e empresas

2. 3. Como o mundo regula a responsabilidade da IA?

2.1. União Europeia

2.1.1. AI Act

2.1.2. Modelo baseado em risco:

2.1.2.1. Proibidos

2.1.2.2. Alto risco

2.1.2.3. Baixo risco

2.1.3. Requisitos: documentação, supervisão humana, logs, segurança, responsabilidade compartilhada

2.2. Brasil

2.2.1. PL 2338/2023

2.2.2. Modelo baseado em risco

2.2.3. Utiliza CDC e Código Civil

2.2.4. Proteção de direitos fundamentais

2.3. Reino Unido

2.3.1. Automated Vehicles Act

2.3.2. Definição de responsáveis:

2.3.2.1. User-in-charge: humano responde

2.3.2.2. No-user-in-charge: empresa responde

3. 2. Bases éticas e principiológicas

3.1. Princípios da OCDE

3.1.1. Centralidade humana

3.1.2. Transparência e explicabilidade

3.1.3. Segurança e robustez

3.1.4. Governança responsável

3.1.5. Crescimento inclusivo

3.2. Influência dos princípios

3.2.1. Atribuição de responsabilidade

4. 4. Elementos técnicos que influenciam a responsabilidade

4.1. Sensores, câmeras, LiDAR → Falhas geram acidentes

4.2. Machine learning → erros imprevisíveis

4.3. Não prevê todas as variáveis

4.4. Complexidade do nexo causal

4.4.1. Fatores técnicos em responsabilidade

5. 5. Responsabilidade Civil

5.1. Dependência de fatores

5.1.1. Nível de autonomia

5.1.2. Conduta do desenvolvedor e operador

5.1.3. Qualidade dos dados e viés

5.1.4. Documentação e logs

5.2. Tendência global

5.2.1. Responsabilidade objetiva em alto risco

6. 6. Responsabilidade Penal

6.1. Obstáculos

6.1.1. IA não tem vontade/consciência do ilícito

6.1.2. Não cumpre dolo ou culpa

6.2. Responsáveis

6.2.1. Programadores (extremos)

6.2.2. Operadores humanos

6.2.3. Empresas (pessoa jurídica)

6.2.4. Usuários negligentes