1. Definições (art. 4º)

1.1. sistema de inteligência artificial (IA)

1.1.1. sistema baseado em máquina que, com graus diferentes de autonomia e para objetivos explícitos ou implícitos, infere, a partir de um conjunto de dados ou informações que recebe, como gerar resultados, em especial previsão, conteúdo, recomendação ou decisão que possa influenciar o ambiente virtual, físico ou real

1.2. ciclo de vida

1.2.1. série de fases desde a concepção, planejamento, desenvolvimento, treinamento, testagem, validação e monitoramento para eventuais modificações e adaptações de um sistema de inteligência artificial, cuja descontinuidade pode ocorrer em quaisquer das etapas referidas

1.3. sistema de inteligência artificial de propósito geral (SIAPG)

1.3.1. sistema de IA baseado em modelo de IA treinado com bases de dados em grande escala, capaz de realizar ampla variedade de tarefas distintas e servir diferentes finalidades, incluindo aquelas para as quais não foram especificamente desenvolvidos e treinados, podendo ser integrado em diversos sistemas ou aplicações

1.4. inteligência artificial generativa (IA generativa)

1.4.1. modelo de IA especificamente destinado a gerar ou modificar significativamente, com diferentes graus de autonomia, texto, imagens, áudio, vídeo ou código de software

1.5. agentes de inteligência artificial

1.5.1. desenvolvedores, distribuidores e aplicadores que atuem na cadeia de valor e na governança interna de sistemas de IA, nos termos definidos por regulamento

1.5.1.1. aplicador

1.5.1.1.1. pessoa natural ou jurídica, de natureza pública ou privada, que empregue ou utilize, em seu nome ou benefício, sistema de IA, inclusive configurando, mantendo ou apoiando com o fornecimento de dados para a operação e o monitoramento do sistema de IA

1.5.1.2. distribuidor

1.5.1.2.1. pessoa natural ou jurídica, de natureza pública ou privada, que disponibilize e distribua sistema de IA para que terceiro o aplique, a título oneroso ou gratuito

1.5.1.3. desenvolvedor

1.5.1.3.1. pessoa natural ou jurídica, de natureza pública ou privada, que desenvolva sistema de IA, diretamente ou por encomenda, com vistas a sua colocação no mercado ou a sua aplicação em serviço por ela fornecido, sob seu próprio nome ou marca, a título oneroso ou gratuito

1.6. autoridade competente

1.6.1. entidade da administração pública federal, dotada de autonomia técnica e decisória, que coordenará o Sistema Nacional de Regulação e Governança de Inteligência Artificial (SIA)

1.7. Sistema Nacional de Regulação e Governança de Inteligência Artificial (SIA)

1.7.1. ecossistema regulatório coordenado pela autoridade competente que tem por finalidade precípua promover e garantir a cooperação e a harmonização com as demais autoridades setoriais e entes reguladores, sem vínculo de subordinação hierárquica entre eles, e outros sistemas nacionais para a plena implementação e fiscalização do cumprimento desta Lei em todo o território nacional, com segurança jurídica

1.8. discriminação abusiva ou ilícita

1.8.1. qualquer distinção, exclusão, restrição ou preferência, em qualquer área da vida pública ou privada, cujo propósito ou efeito seja anular ou restringir, de forma abusiva ou ilícita, o reconhecimento, o gozo ou o exercício, em condições de igualdade, de um ou mais direitos ou liberdades previstos no ordenamento jurídico, em razão de características pessoais

1.9. discriminação indireta abusiva ou ilícita

1.9.1. discriminação que ocorre quando normativa, prática ou critério aparentemente neutro tem a capacidade de acarretar desvantagem para pessoa ou grupos afetados, ou os coloquem em desvantagem, desde que essa normativa, prática ou critério seja abusivo ou ilícito

1.10. mineração de textos e dados

1.10.1. processo de extração e análise de grandes quantidades de dados, com alto grau de automação, realizado de forma direta nos dados primários, ou indireta por meio de outra ferramenta, a partir dos quais são extraídos padrões e correlações que gerarão informações relevantes para a pesquisa, o desenvolvimento ou a utilização de sistemas de IA

1.11. pessoa ou grupo afetado

1.11.1. pessoa natural ou grupo de pessoas que seja direta ou indiretamente impactado por sistema de IA

1.12. avaliação preliminar

1.12.1. processo simplificado de autoavaliação, anterior à utilização ou colocação no mercado de um ou mais sistemas de IA, para classificação de seu grau de risco, com o objetivo de determinar o cumprimento das obrigações definidas nesta Lei

1.13. avaliação de impacto algorítmico

1.13.1. análise do impacto sobre os direitos fundamentais, apresentando medidas preventivas, mitigadoras e de reversão dos impactos negativos, bem como medidas potencializadoras dos impactos positivos de um sistema de IA

1.14. vulnerabilidade

1.14.1. estado de assimetria agravada de informação ou de poder que afeta pessoas naturais ou grupos em razão, entre outras, de suas condições cognitivas, sociais, étnicas, econômicas e etárias, a exemplo de crianças e adolescentes, idosos e pessoas com deficiência

1.15. ambiente regulatório experimental (sandbox regulatório)

1.15.1. conjunto de condições especiais estabelecidas para desenvolver, treinar, validar e testar, por tempo limitado, um sistema de IA inovador, bem como modelos de negócio e políticas públicas inovadoras e técnicas e tecnologias experimentais que envolvam IA, mediante o cumprimento de critérios e de limites previamente estabelecidos e por meio de procedimento facilitado

1.16. estado da arte do desenvolvimento tecnológico

1.16.1. meios técnicos razoáveis e disponíveis, baseado em evidências científicas, tecnológicas e boas práticas consolidadas

1.17. efeitos jurídicos relevantes

1.17.1. consequências jurídicas modificativas, impeditivas ou extintivas negativas que atingem direitos e liberdades fundamentai

1.18. conteúdos sintéticos

1.18.1. informações, tais como imagens, vídeos, áudio e texto, que foram significativamente modificadas ou geradas por sistemas de IA

1.19. integridade informacional

1.19.1. resultado de um ecossistema informacional que viabiliza e disponibiliza informações e conhecimento confiáveis, diversos e precisos, em tempo hábil para promoção da liberdade de expressão

1.20. identificação biométrica

1.20.1. método que envolve o reconhecimento de características físicas, fisiológicas e comportamentais humanas, com o propósito de identificar um indivíduo

1.21. autenticação biométrica

1.21.1. processo de verificação ou confirmação da identidade de um indivíduo, com o objetivo de singularizá-lo, por meio da comparação de suas características biométricas obtidas a partir de um modelo previamente armazenado

1.22. introdução ou colocação em circulação no mercado

1.22.1. disponibilização inicial ou introdução para usuários do sistema de IA, a título oneroso ou gratuito

1.23. autoridades setoriais

1.23.1. órgãos e entidades do Poder Executivo federal responsáveis pela regulação de setores específicos da atividade econômica e governamental, conforme sua competência legal

1.24. sistemas de armas autônomas (SAA)

1.24.1. sistemas que, uma vez ativados, podem selecionar e atacar alvos sem intervenção humana adicional

1.25. interface de programação de aplicação (API)

1.25.1. conjunto de protocolos e funções que permitem que diferentes sistemas interajam entre si

1.26. contexto de uso

1.26.1. utilização específica à qual é destinado o sistema ou aplicação de IA, incluindo o sistema a ser utilizado, o contexto e a finalidade específicos e suas condições de utilização

1.27. risco sistêmico

1.27.1. potenciais efeitos adversos negativos decorrentes de um sistema de IA de propósito geral e generativa com impacto significativo sobre direitos fundamentais individuais e sociais

2. Hipóteses de não aplicação (Art. 1º, § 1º)

2.1. sistema de IA usado por pessoa natural para fim exclusivamente particular e não econômico

2.2. sistema de IA desenvolvidos e utilizados exclusivamente para fins de defesa nacional

2.3. atividades de investigação, pesquisa, testagem e desenvolvimento de sistemas, aplicações ou modelos de IA antes de serem colocados em circulação no mercado ou colocados em serviço

2.4. sistema de IA utilizado em serviços que se limitem ao provimento de infraestrutura de armazenamento e transporte de dados empregados em sistemas de IA

3. Regimes simplificados (Art. 1º, § 2º)

3.1. Cf. regulamentação do SIA

3.1.1. padrões e formatos abertos e livres, com exceção daqueles considerados de alto risco

3.1.2. incentivo à inovação e à pesquisa científica e tecnológica no ambiente produtivo, com vistas à capacitação tecnológica, ao alcance da autonomia tecnológica e ao desenvolvimento do sistema produtivo nacional e regional do País

3.1.3. projetos de interesse público, os que atendam as prioridades das políticas industrial e de ciência, tecnologia e inovação e os que visem à solução dos problemas brasileiros

4. Fundamentos (Art. 2º)

4.1. centralidade da pessoa humana

4.2. respeito e promoção aos direitos humanos e aos valores democráticos

4.3. livre desenvolvimento da personalidade e liberdade de expressão

4.4. proteção ao meio ambiente e ao desenvolvimento ecologicamente equilibrado

4.5. igualdade, não discriminação, pluralidade e diversidade

4.6. direitos sociais, em especial a valorização do trabalho humano

4.7. desenvolvimento econômico, científico e tecnológico e inovação

4.8. defesa do consumidor, livre iniciativa e livre concorrência

4.9. privacidade, proteção de dados pessoais e autodeterminação informativa

4.10. promoção da pesquisa e do desenvolvimento com a finalidade de estimular a inovação nos setores produtivos e no poder público, bem como parcerias público-privadas

4.11. acesso à informação e a disseminação de dados, de forma aberta e estruturada

4.12. proteção de direitos culturais e a promoção dos bens artísticos e históricos

4.13. educação e conscientização sobre os sistemas de IA para a promoção do pleno desenvolvimento e do exercício da cidadania

4.14. proteção e promoção de direitos de grupos vulneráveis, em especial de idosos, pessoas com deficiência e, com proteção integral e visando ao melhor interesse, de crianças e adolescentes, reconhecendo a vulnerabilidade agravada

4.15. integridade da informação mediante a proteção e a promoção da confiabilidade, da precisão e da consistência das informações para o fortalecimento da liberdade de expressão, do acesso à informação e dos demais direitos fundamentais

4.16. fortalecimento do processo democrático, pluralismo político

4.17. proteção de direitos de autor e conexos, de direitos de propriedade intelectual e do segredo comercial e industrial

4.18. garantia da segurança da informação e segurança cibernética

4.19. inserção, integração e competitividade brasileira no mercado internacional

4.20. cooperação internacional para o desenvolvimento e o atendimento a padrões técnicos e a regimes de obrigações nacionais e internacionais

5. Princípios (Art. 3º)

5.1. crescimento inclusivo, desenvolvimento sustentável e bem-estar, incluindo a proteção do trabalho e do trabalhador

5.2. autodeterminação e liberdade de decisão e de escolha

5.3. supervisão e determinação humana efetiva e adequada no ciclo de vida da IA, considerando o grau de risco envolvido

5.4. não discriminação ilícita e abusiva

5.5. justiça, equidade e inclusão

5.6. transparência e explicabilidade, observado o segredo comercial e industrial, considerada a participação de cada agente na cadeia de valor de IA

5.7. diligência devida e auditabilidade ao longo de todo o ciclo de vida do sistema de IA, de acordo com o risco envolvido e o estado da arte do desenvolvimento tecnológico

5.8. confiabilidade e robustez do sistema de IA

5.9. proteção dos direitos e garantias fundamentais, incluindo o devido processo legal, contestabilidade e contraditório

5.10. prestação de contas, responsabilização e reparação integral de danos

5.11. prevenção, precaução e mitigação de riscos e danos

5.12. não maleficência e proporcionalidade entre os métodos empregados e as finalidades determinadas e legítimas do sistema de IA

5.13. desenvolvimento e uso ético e responsável da IA

5.14. governança transparente, participativa e orientada à proteção de direitos fundamentais individuais, sociais, coletivos e econômicos

5.15. promoção da interoperabilidade de IA para permitir um acesso mais amplo e inovação colaborativa

5.16. possibilidade e condição de utilização de sistemas e tecnologias com segurança e autonomia, por pessoa com deficiência, garantida a plena acessibilidade à informação e à comunicação

5.17. proteção integral das crianças e dos adolescente

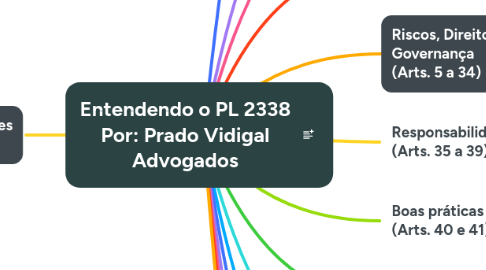

6. Riscos, Direitos e Medidas de Governança (Arts. 5 a 34)

6.1. Avaliação preliminar (Art. 12)

6.1.1. Risco excessivo (vedações) (Art. 13)

6.1.1.1. Sistemas de IA com os seguintes propósitos:

6.1.1.1.1. instigar ou induzir o comportamento da pessoa natural ou de grupos de maneira que cause danos à saúde, à segurança ou a outros direitos fundamentais próprios ou de terceiros

6.1.1.1.2. explorar quaisquer vulnerabilidades da pessoa natural ou de grupos com o objetivo ou o efeito de induzir o seu comportamento de maneira que cause danos à saúde, à segurança ou outros a direitos fundamentais próprios ou de terceiros

6.1.1.1.3. avaliar os traços de personalidade, as características ou o comportamento passado, criminal ou não, de pessoas singulares ou grupos, para avaliação de risco de cometimento de crimes, de infrações ou de reincidência

6.1.1.1.4. possibilitar a produção ou disseminação ou facilitar a criação de material que caracterize ou represente abuso ou exploração sexual de crianças e adolescentes

6.1.1.2. IA pelo poder público, para avaliar, classificar ou ranquear as pessoas naturais, com base no seu comportamento social ou em atributos da sua personalidade, por meio de pontuação universal, para o acesso a bens e serviços e políticas públicas, de forma ilegítima ou desproporcional

6.1.1.3. IA em sistemas de armas autônomas (SAA)

6.1.1.4. IA em sistemas de identificação biométrica à distância, em tempo real e em espaços acessíveis ao público

6.1.1.4.1. exceções

6.1.2. Risco alto

6.1.2.1. Classificação (Arts. 14 a 16)

6.1.2.1.1. rol trazido pela legislação

6.1.2.1.2. critérios de futura regualmentação pelo SIA

6.1.2.2. Direitos (Art. 6º)

6.1.2.2.1. direito à explicação sobre a decisão, a recomendação ou a previsão feitas pelo sistema

6.1.2.2.2. direito de contestar e de solicitar a revisão de decisões, recomendações ou previsões de sistema de IA

6.1.2.2.3. direito à revisão humana das decisões, levando-se em conta o contexto, o risco e o estado da arte do desenvolvimento tecnológico

6.1.2.2.4. + Direitos artigos 5o

6.1.2.3. Medidas de governança (Arts. 18 a 34)

6.1.2.3.1. Aplicador (Art. 18, I, e 25)

6.1.2.3.2. Desenvolvedor (Art. 18, II, e 25)

6.1.2.3.3. Distribuidor (Art. 16, §3º)

6.1.3. Demais sistemas

6.1.3.1. Direitos (Art. 5º)

6.1.3.1.1. direito à informação quanto às suas interações com sistemas de IA, de forma acessível, gratuita e de fácil compreensão, inclusive sobre caráter automatizado da interação

6.1.3.1.2. direito à privacidade e à proteção de dados pessoais

6.1.3.1.3. direito à não discriminação ilícita ou abusiva e à correção de vieses discriminatórios ilegais ou abusivos, sejam eles diretos ou indiretos

6.1.3.2. Medidas de governança (Art. 17)

6.1.3.2.1. Sistema gerais (art. 17)

6.1.3.2.2. Sistema que gera conteúdo sintético (Arts. 19 e 20)

6.1.3.2.3. Sistemas de Inteligência Artificial de Propósito Geral e Generativa (Art. 29)

6.2. Certificação (Art. 34)

6.2.1. A autoridade competente e as autoridades setoriais poderão acreditar organismos de avaliação de conformidade nacionais ou internacionais especializados em governança de sistemas de IA para avaliar o cumprimento das medidas de governança e processos internos exigidos pelos órgãos reguladores

7. Responsabilidade civil (Arts. 35 a 39)

7.1. regimes já existentes na legislação

7.1.1. critérios para definição

7.1.1.1. nível de autonomia do sistema e grau de risco

7.1.1.2. natureza dos agentes envolvidos e a consequente existência de regime de responsabilidade civil próprio na legislação

7.2. possibilidade de inversão do ônus da prova

7.2.1. quando a vítima for hipossuficiente ou quando as características de funcionamento do sistema de IA tornarem excessivamente oneroso para a vítima provar os requisitos da responsabilidade civil

7.3. testagem não está isenta

7.3.1. comprovação do agente de que não colocou em circulação, empregou ou tirou proveito do sistema de inteligência artificial; ou

7.3.2. comprovação de que o dano é decorrente de fato exclusivo da vítima ou de terceiro, assim como de caso fortuito externo

8. Boas práticas (Arts. 40 e 41)

8.1. Códigos de boas práticas e de governança

8.1.1. condições de organização

8.1.2. regime de funcionamento, os procedimentos, inclusive sobre reclamações das pessoas afetadas

8.1.3. normas de segurança, os padrões técnicos

8.1.4. obrigações específicas para cada contexto de implementação,

8.1.5. ações educativas, os mecanismos internos de supervisão e de mitigação de riscos

8.1.6. medidas de segurança técnicas e organizacionais apropriadas para a gestão dos riscos decorrentes da aplicação dos sistemas

8.2. Programa de governança

8.2.1. que demonstre o comprometimento em adotar processos e políticas internas que assegurem o cumprimento, de forma abrangente, de normas e boas práticas relativas à não maleficência e proporcionalidade entre os métodos empregados e as finalidades determinadas e legítimas dos sistemas de inteligência artificial

8.2.2. adptado à estrutura, à escala e ao volume de suas operações, bem como ao seu potencial danoso e de benefícios

8.2.3. com o objetivo de estabelecer relação de confiança com as pessoas afetadas, por meio de atuação transparente e que assegure mecanismos de participação

8.2.4. integrado à sua estrutura geral de governança e estabeleça e aplique mecanismos de supervisão internos e externos

8.2.5. contendo planos de resposta para reversão dos possíveis resultados prejudiciais do sistema de inteligência artificial

8.2.6. atualizado constantemente com base em informações obtidas a partir de monitoramento contínuo e avaliações periódicas

8.2.7. incluindo mecanismos e procedimentos internos de integridade, auditoria e incentivo à denúncia de irregularidades e a aplicação efetiva de códigos de ética

8.3. Adesão voluntária a código de boas práticas e a elaboração de medidas de governança podem ser consideradas indicativo de boa-fé

8.4. Autorregulação

8.4.1. Os agentes de inteligência artificial podem associar-se voluntariamente sob a forma de pessoa jurídica de direito privado sem fins lucrativos para promover a autorregulação com o objetivo de incentivar e assegurar melhores práticas de governança

8.4.1.1. estabelecer critérios técnicos dos sistemas de inteligência artificial aplicada, inclusive de padronização, prudenciais e de atuação concertada dos entes associados, desde que não impeçam o desenvolvimento tecnológico e em conformidade com normas aplicáveis

8.4.1.2. compartilhamento de experiências sobre o uso de inteligência artificial;

8.4.1.3. definição contextual de estruturas de governança previstas na Lei

8.4.1.4. critérios para provocar das autoridades/agências emprego de medida cautelar e canal de recebimento de informações relevantes sobre riscos do uso de inteligência artificial por seus associados ou qualquer interessado (?)

9. Comunicação de incidentes graves (Arts. 42 e 43)

9.1. Critérios exeplificativos

9.1.1. graves violações aos direitos fundamentais, à integridade da informação, à liberdade de expressão e ao processo democrático

9.1.2. graves danos à propriedade ou ao meio ambiente

9.1.3. interrupção de funcionamento de operações críticas de infraestrutura

9.1.4. risco à vida e integridade física de pessoas

9.2. Deverão ser comunicados pelos agentes à autoridade setorial, nos termos de regulamento

9.2.1. A autoridade setorial verificará a gravidade do incidente e poderá, caso necessário, determinar ao agente a adoção de providências e medidas para reverter ou mitigar os efeitos do incidente

10. Base de dados pública de IA para sistemas de alto risco (Art. 44)

10.1. com documentos públicos das avaliações de impacto

10.2. criada e mantida pela autoridade competente, em colaboração com autoridades setoriais

10.3. não impede a criação de bases de IA de alto risco setoriais

11. Supervisão e fiscalização (Art. 45 a 50)

11.1. Sistema Nacional de Regulação e Governança de Inteligência Artificial - SIA

11.1.1. Composição

11.1.1.1. autoridade competente (coordenação)

11.1.1.1.1. ANPD

11.1.1.2. autoridades setoriais

11.1.1.2.1. composição

11.1.1.2.2. competências

11.1.1.3. Comitê de Especialistas e Cientistas de Inteligência Artificial (Cecia)

11.1.1.3.1. orientar e supervisionar técnica e cientificamente o desenvolvimento e a aplicação da IA de forma responsável, nos termos definidos por regulamento

11.1.1.4. Conselho Permanente de Cooperação Regulatória de Inteligência Artificial (Cria)

11.1.1.4.1. produção de diretrizes e será fórum permanente de colboração, inclusive por meio de acordos de cooperação técnica, com as autoridades setoriais e com a sociedade civil, a fim de harmonizar e facilitar o exercício das atribuições da autoridade competente

11.1.2. Objetivos e fundamentos

11.1.2.1. valorizar e reforçar as competências regulatória, sancionatória e normativa das autoridades setoriais em harmonia com as competências correlatas gerais da autoridade competente que coordena o SIA

11.1.2.2. buscar a harmonização e a colaboração com órgãos reguladores de temas transversais

11.2. Sanções

11.2.1. rol de sanções

11.2.1.1. advertência

11.2.1.2. multa simples, limitada, no total, a R$ 50.000.000,00 (cinquenta milhões de reais) por infração, sendo, no caso de pessoa jurídica de direito privado, de até 2% (dois por cento) de seu faturamento, de seu grupo ou conglomerado no Brasil no seu último exercício, excluídos os tributos

11.2.1.3. publicização da infração após devidamente apurada e confirmada a sua ocorrência

11.2.1.4. proibição ou restrição para participar do regime de sandbox regulatório previsto nesta Lei, por até 5 (cinco ) anos

11.2.1.5. suspensão parcial ou total, temporária ou definitiva, do desenvolvimento, fornecimento ou operação do sistema de inteligência artificial

11.2.1.6. proibição de tratamento de determinadas bases de dados

11.2.2. parâmetros e critérios

11.2.2.1. gravidade e a natureza das infrações e a eventual violação de direitos

11.2.2.2. boa-fé do infrator

11.2.2.3. vantagem auferida ou pretendida pelo infrator

11.2.2.4. condição econômica do infrator

11.2.2.5. reincidência

11.2.2.6. grau do dano

11.2.2.7. cooperação do infrator

11.2.2.8. adoção reiterada e demonstrada de mecanismos e procedimentos internos capazes de minimizar riscos, inclusive a análise de impacto algorítmico e efetiva implementação de código de ética

11.2.2.9. a adoção de política de boas práticas e governança

11.2.2.10. a pronta adoção de medidas corretivas

11.2.2.11. a proporcionalidade entre a gravidade da falta e a intensidade da sanção

11.2.2.12. a cumulação com outras sanções administrativas eventualmente já aplicadas em definitivo para o mesmo ato ilícito

12. Ambiente regulatório experimental - sandbox regulatório de IA (Arts. 55 a 57)

12.1. facilitar o desenvolvimento, a testagem e a validação de sistemas inovadores de IA por um período limitado antes da sua colocação no mercado ou colocação em serviço de acordo com um plano específico, a fim de desenvolver negócios inovadores de maneira segura

12.1.1. A autoridade competente e as autoridades setoriais que compõem o SIA deverão promover e autorizar o funcionamento de ambiente regulatório experimental para inovação em inteligência artificial

12.1.2. A autoridade competente e as autoridades setoriais poderão, individualmente ou em colaboração, no âmbito de programas de ambiente regulatório experimental (sandbox regulatório), afastar a incidência de normas sob sua competência em relação à entidade regulada ou aos grupos de entidades reguladas

13. Diretrizes para proteção trabalho e aos trabalhadores (Art. 58)

13.1. A autoridade competente, as autoridades setoriais que compõem o SIA e o Cria, em cooperação com o Ministério do Trabalho, deverão desenvolver diretrizes relacionadas à proteção ao trabalho e aos trabalhadores.

14. Medidas de Incentivo e Sustentabilidade (Art. 59 a 61)

14.1. A administração pública no âmbito da União, dos Estados, do Distrito Federal e dos Municípios poderá fomentar a inovação e o desenvolvimento produtivo e tecnológico em IA.

14.2. Entidades públicas e privadas devem priorizar a utilização de sistemas e aplicações de IA que visem à eficiência energética e à racionalização do consumo de recursos naturais

15. Direitos autorais e conexos (Arts. 62 a 66)

15.1. dever de informação

15.1.1. desenvolvedor de IA que utilizar conteúdo protegido por direitos de autor e conexos deverá informar sobre os conteúdos protegidos utilizados nos processos de desenvolvimento dos sistemas de IA, por meio da publicação de sumário em sítio eletrônico de fácil acesso, observados os segredos comercial e industrial, nos termos de regulamento específico

15.2. limitações

15.2.1. Não constitui ofensa aos direitos de autor e conexos a utilização automatizada de conteúdos protegidos em processos de mineração de textos e dados para os fins de pesquisa e desenvolvimento de sistemas de IA por organizações e instituições científicas, de pesquisa e educacionais, museus, arquivos públicos e bibliotecas

15.2.1.1. condições

15.2.1.1.1. acesso licito

15.2.1.1.2. sem fins comerciais

15.2.1.1.3. utilização de conteúdos protegidos por direitos de autor e conexos seja feita na medida necessária para o objetivo a ser alcançado, sem prejuízo dos interesses econômicos dos titulares e sem concorrência com a exploração normal das obras e conteúdos protegidos

15.2.1.1.4. limitação não se aplica a instituições vinculadas, coligadas ou controladas por entidade com fins lucrativos que forneçam sistemas de IA ou que tenham, entre elas, participação acionária

15.3. fora das hipóteses de limitação, titular de direitos de autor e conexos poderá proibir a utilização dos conteúdos de sua titularidade no desenvolvimento de sistemas de inteligência artificial

15.4. remuneração dos titulares por parte de agende de IA que utilizar conteúdos protegidos por direitos de autor e conexos em processos de mineração, treinamento ou desenvolvimento de sistemas de IA

15.4.1. negociação coletiva ou individual

15.4.2. aos titulares de direitos de autor e conexos nacionais ou estrangeiros domiciliados no Brasil

15.4.3. a pessoas domiciliadas em país que assegure a reciprocidade na proteção, em termos equivalentes a este artigo, aos direitos de autor e conexos de brasileiros, sendo vedada a cobrança nos casos em que a reciprocidade não estiver assegurada

16. Entrada em vigor (Art. 80)

16.1. Risco excessivo (vedações) e medidas de governança Medidas de Governança para Sistemas de Inteligência Artificial de Propósito Geral e Generativa, regras relativas a direitos autorais

16.1.1. 180 dias

16.2. Demais direitos e obrigações

16.2.1. 730 dias

16.3. Artigo 62 (restrição de uso de DA), supervisão, fiscalização (menos sanções), medidas de incentivo e sustentabilidade e incentivo a microempresa, EPP e startups

16.3.1. data da publicação