1. Distribución de probabilidad

1.1. Distribución empírica

1.1.1. Enfocamos la atención en el número de águilas obtenido cada vez que se realizó el experimento y enseguida aplicamos las herramientas estadísticas.

1.2. Distribución teórica

1.2.1. No repetimos los experimentos, sino que trabajamos sobre los posibles resultados distintos. Es decir, analizamos el espacio muestra

2. Histograma

2.1. Cuando hablamos de distribuciones de probabilidad, el gráfico que se usa con mayor frecuencia es el histograma, aunque la variable sea discreta.

2.2. En estadística, un histograma es una representación gráfica de una variable en forma de barras, donde la superficie de cada barra es proporcional a la frecuencia de los valores representados.

3. Variable aleatoria

3.1. Discretas

3.1.1. Es una variable cuantitativa que puede tomar una cantidad numerable de valores.

3.1.1.1. Ejemplos de variables aleatorias discretas: • Número de hijos por familia. • Suma de puntos al lanzar dos dados.

3.2. Continuas

3.2.1. Es una variable cuantitativa que puede tomar una cantidad innumerable de valores.

3.2.1.1. Ejemplos de variables aleatorias continuas: • La estatura de un grupo de personas. • El tiempo en que se realiza una tarea.

4. Función de probabilidad

4.1. Algunas veces es conveniente escribir una regla que exprese algebraicamente la probabilidad de un suceso en términos del valor de la variable aleatoria. Esta expresión suele escribirse como una fórmula y se denomina función de probabilidad. Es una función expresada por medio de una fórmula matemática que nos permite calcular las probabilidades asociadas con los diversos valores de una variable aleatoria.

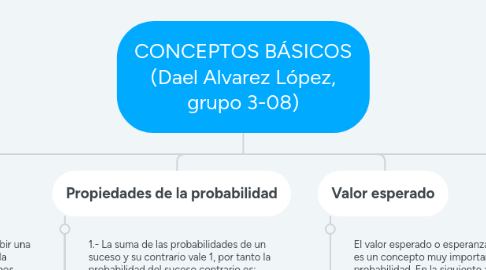

5. Propiedades de la probabilidad

5.1. 1.- La suma de las probabilidades de un suceso y su contrario vale 1, por tanto la probabilidad del suceso contrario es: {{P(\bar{A}) = 1 - P(A)}}

5.2. 2.- Probabilidad del suceso imposible es cero. {{P(\varnothing )=0}}

5.3. 3.- La probabilidad de la unión de dos sucesos es la suma de sus probabilidades menos la probabilidad de su intersección. {{P(A\cup B)= P(A)+P(B) - P(A\cap B)}}

5.4. 4.- Si un suceso A está incluido en otro suceso B, entonces la probabilidad de A es menor o igual a la probabilidad de B. {{A\subset B \Rightarrow P(A)\leq P(B)}}

5.5. 5.- Si A1, A2, ..., Ak son incompatibles dos a dos entonces: {{P(A_1\cup A_2\cup ... \cup A_k) = P(A_1)+P(A_2)+\cdot \cdot \cdot + P(A_k)}}

5.6. 6.- Si el espacio muestral E es finito y un suceso es S = {x1, x2, ..., xn} entonces: {{P(S) = P(x_1)+P(x_2)+\cdot \cdot \cdot + P(x_n)}}

6. Valor esperado

6.1. El valor esperado o esperanza matemática, es un concepto muy importante en probabilidad. En la siguiente actividad, podrás explorar este concepto.

7. Jugo equitatvo

7.1. Un juego es equitativo, si la esperanza de la cantidad ganada por cada jugador es la misma.

7.1.1. En situaciones de azar, un criterio para “apostar” es esperar un juego justo o equitativo. A continuación, convertiremos el juego entre A y B en uno equitativo, con los siguientes cambios:

7.1.1.1. • Si sale 0, 1 ó 2 el jugador A gana un peso. • Si sale 3, 4 ó 5 el jugador B gana dos pesos.

8. Medida de una distribución

8.1. Al igual que para describir conjuntos de datos se utilizan los promedios y las medidas de dispersión, para describir una distribución de probabilidad se usan la media y la desviación estándar.

8.1.1. La media de una distribución de probabilidad denotada con la letra griega µ (mu) se define como el valor esperado de la variable aleatoria.