1. El código binario y el sistema binario hacen referencia a conceptos de sobra conocidos dentro del mundo de las tecnologías de la información. Se trata de un sistema de numeración en el que los números se representan utilizando solamente dos cifras: cero y uno. Este sistema de codificación se utiliza, entre otras muchas cosas, para representar textos o procesar instrucciones. Aunque pueda resultar difícil de entender para aquellas personas que solo conocen el sistema decimal, el código binario nos ofrece una serie de ventajas debido a su sencillez y versatilidad y, además, es el sistema más adecuado desde un punto de vista técnico.

2. Todo lo que hemos comentado hasta ahora se refiere al llamado código binario natural. Sin embargo existen distintos tipos de códigos binarios, que son empleados según favorezcan el proceso que se va a realizar con ellos, ya que son más eficientes en la ejecución de determinadas operaciones. Veamos los más importantes:

3. CÓDIGOS ALFANUMÉRICOS Un código alfanumérico muy popular y ampliamente utilizado, es el llamado código ASCII (American Standard Code for Information Interchange), que en español quiere decir: código estándar americano para el intercambio de información, el cual es un código de siete bits muy utilizado en los sistemas digitales avanzados (computadores, redes de transmisión de datos, etc.) para representar hasta 128 (27) piezas de información diferentes, incluyendo letras, números, signos de puntuación, instrucciones y caracteres especiales.

3.1. CÓDIGOS ASCII El código ASCII (siglas en inglés para American Standard Code for Information Interchange, es decir Código Americano ( Je! lease estadounidense... ) Estándar para el intercambio de Información) (se pronuncia Aski). Fue creado en 1963 por el Comité Estadounidense de Estándares o "ASA", este organismo cambio su nombre en 1969 por "Instituto Estadounidense de Estándares Nacionales" o "ANSI" como se lo conoce desde entonces.

3.1.1. CODIGOS ASCII EXTENDIDOS Se denomina ASCII extendido a cualquier juego de caracteres de 8 bits, en el cual los códigos 32 a 126 (0x20 a 0x7E) coinciden con los caracteres imprimibles de ASCII, así como los caracteres comúnmente llamados "de espacio", estos son los códigos de control de 8 a 13 (0x08 a 0x0D), ambos inclusive. Las codificaciones de ASCII extendido utilizan además parte o la totalidad de los códigos superiores a 128 para codificar caracteres adicionales a los caracteres imprimibles ASCII. Codificaciones "ASCII extendido" más comunes Página de códigos 437, usual en las versiones en inglés del IBM PC y MS-DOS. Página de códigos 850, usual en las versiones de Europa occidental del IBM PC y MS-DOS. Latin-1 (ISO-8859-1), típico de Unix, y, con modificaciones, en Microsoft Windows (Windows- 1252) y Macintosh

4. CÓDIGO BINARIO NATURAL El Código Binario natural es el que todos nosotros conocemos comúnmente como código binario, es un sistema de numeración posicional ponderado en base 2, esto quiere decir que solamente se emplean dos símbolos y sirve para representar cantidades numéricas. A cada dígito de una combinación se le llama bit. Al ser la base igual a 2, la representación decimal de un número binario se halla por el Teorema Fundamental de la Numeración como sumas de potencias de 2. Además, se cumple que con una cadena de n bits se pueden representar [2^n] combinaciones. Ejemplo 35(10 = 100011(2

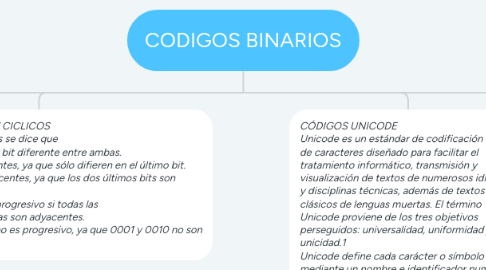

5. ÓDIGOS PROGRESIVOS Y CICLICOS Dos codificaciones binarias se dice que son adyacentes si sólo hay bit diferente entre ambas. -0000 y 0001 son adyacentes, ya que sólo difieren en el último bit. -0001 y 0010 no son adyacentes, ya que los dos últimos bits son diferentes. Un código se dice que es progresivo si todas las codificaciones consecutivas son adyacentes. -El código binario natural no es progresivo, ya que 0001 y 0010 no son adyacentes

5.1. CÓDIGOS BCD Los códigos BCD (decimal codificado en binario) son códigos de 4 bits en los que solamente existen diez combinaciones válidas, que se usan para representar las cifras del 0 al 9 y que servirán para codificar cada una de las cifras de un número decimal por medio de combinaciones binarias. En esto se diferencia del código binario natural, en el que cada número decimal tiene asociada una secuencia de bits diferente (por lo que existen infinitas combinaciones posibles). EJEMPLO El siguiente numero binario, en la codificación normal, representa al 55: 0011 0111. Por el contrario, en la codificación BCD se representa al 5 en cuatro bits en 8421 y queda como: 0101, por lo tanto, en BCD quedaría como: 0101 0101.

5.1.1. CÓDIGO GRAY El código Gray es otro tipo de código basado en un sistema binario pero de una construcción muy distinta a la de los demás códigos. Su principal característica es que 2 números sucesivos, cualesquiera, solo varían en 1 bit. Esto se consigue mediante un proceso poco riguroso que consiste en: 0 0 0 00 Se escribe en una columna los dígitos 0 y 1 1 1 1 01 Se toma una línea imaginaria en la base de la columna. - - - - --- Se reproduce la columna bajo la línea como si de un espejo. 1 11 se tratase 0 10 Se rellenan las dos zonas con 0s y con 1s