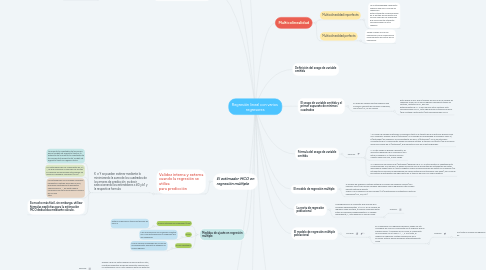

1. Validez externa

1.1. La cuestión de si el análisis para California puede generalizarse, es decir, si es externamente válido, depende de la población y el escenario para los que se realiza la generalización. En este caso, se considera si los resultados pueden generalizarse al desempeño en otros exámenes estandarizados de otros distritos de escuelas primarias públicas en los Estados Unidos.

2. Si el regresor está correlacionado con un variable que ha sido omitida en un análisis y esta determina, en parte, la variable dependiente el estimador MCO presentará sesgo de variable omitida

2.1. Este sesgo se presenta cuando se cumplen dos condiciones:

2.1.1. 1. Cuando la variable omitida está correlacionada con los regresores incluidos en la regresión

2.1.2. 2. Cuando la variable omitida es un factor determinante de la variable dependiente.

3. El modelo de regresión múltiple

3.1. Este modelo permite estimar el efecto sobre Yi de la variación de una variable (X1i) manteniendo constantes el resto de regresores (X2i, X3i, etc.).

3.1.1. El modelo de regresión múltiple poblacional

3.1.1.1. Es la relación entre Y y X_1 y X_2 que se cumple en media en la población.

3.1.1.1.1. Las definiciones de homocedasticidad y heterocedasticidad en el modelo de regresión múltiple son extensiones de sus definiciones para el modelo de regresión con regresor único.

3.1.1.2. Yi=B_0+B_1X_1i+B_2X_2i+Ui, i=1, ..., n,

3.2. E(Yi | X_1i=x_1, X_2i=x_2)=B_0+B_1x1+B_2x2

4. Los supuestos de mínimos cuadrados en regresión múltiple

4.1. Supuesto 1: La distribución condicional de ui dados tiene media igual a cero

4.1.1. Este supuesto significa que Yi a veces se encuentra por encima del hiperplano de regresión poblacional y otras veces Yi se encuentra por debajo del hiperplano de regresión, pero en promedio sobre la población Yi se encuentra en el hiperplano de regresión poblacional.

4.2. Supuesto 2: son i.i.d.

4.2.1. Se cumple de forma automática si los datos se han obtenido por muestreo aleatorio simple.

4.3. Supuesto 3: Los valores atípicos elevados son improbables

4.3.1. El supuesto de que los valores atípicos grandes son poco probables se formula de un modo matemáticamente preciso suponiendo que X1i, ..., Xki e Yi presentan momentos de cuarto orden finitos y distintos de cero: 0 < E(X4 1i) < ∞, ..., 0 < E(X4 ki) < ∞ y 0 <E(Y4i) <∞ . Otra forma de formular este supuesto es que la variable dependiente y los regresores presentan curtosis finita

4.4. Supuesto 4: Ausencia de multicolinealidad perfecta

4.4.1. La solución a la aparición de la multicolinealidad perfecta en esta regresión hipotética consiste simplemente en corregir el error tipográfico y reemplazar una de las apariciones de la variable REM por la variable que originalmente se quería incluir. Este es un ejemplo típico: cuando se presenta multicolinealidad perfecta, a menudo es el reflejo de un error lógico en la elección de los regresores o bien alguna otra característica particular no reconocida previamente del conjunto de datos.

5. El estimador MCO en regresión múltiple

5.1. Validez interna y externa cuando la regresión se utiliza para predicción

5.1.1. X e Y se pueden estimar mediante la minimizando la suma de los cuadrados de los errores de predicción, es decir, seleccionando los estimadores s b0 y b1 y la respectiva formula.

5.1.1.1. La suma de los cuadrados de los errores para el modelo de regresión lineal es la extensión de la suma de los cuadrados de los errores de la ecuación del modelo de regresión lineal con regresor único.

5.1.1.2. Los estimadores de los coeficientes b0, b1, ..., bk que minimizan la suma de los errores al cuadrado se denominan estimadores de mínimos cuadrados ordinarios (MCO)

5.1.1.3. Los estimadores MCO pueden calcularse mediante el método de prueba y error, probando repetidamente diferentes valores para b0, ..., bk hasta llegar a considerar que se ha alcanzado el mínimo de la suma total.

5.1.1.4. Es mucho más fácil, sin embargo, utilizar fórmulas explícitas para la estimación MCO deducidas mediante cálculo.

6. Medidas de ajuste en regresión múltiple

6.1. El error estándar de la regresión (ESR)

6.1.1. Estima la desviación típica del término de error ui .

6.2. El R2

6.2.1. n es la proporción de la varianza muestral de Yi que está explicada (o predicha) por los regresores

6.3. El «R2 ajustado»

6.3.1. Es una versión modificada de R2 que no necesariamente aumenta al añadirse un nuevo regresor

7. La distribución de los estimadores MCO en regresión múltiple

7.1. Debido a que los datos difieren de una muestra a otra, muestras diferentes producen diferentes valores para los estimadores MCO. Esta variación entre las distintas muestras posibles da lugar a la incertidumbre asociada a los estimadores MCO de los coeficientes de regresión poblacionales

7.1.1. Formula:

7.2. Multicolinealidad

7.2.1. La multicolinealidad perfecta surge cuando uno de los regresores es una combinación lineal perfecta del restos de los regresores.

7.2.2. La multicolinealidad imperfecta surge cuando uno de los regresores está muy altamente correlacionado, pero no perfectamente correlacionado, con los otros regresores. A diferencia de la multicolinealidad perfecta, la multicolinealidad imperfecta no impide la estimación de la regresión, ni implica un problema lógico en la selección de los regresores. Sin embargo, esto no significa que uno o más coeficientes de la regresión puedan estimarse de forma imprecisa.

7.3. La trampa de la variable ficticia

7.3.1. Otra posible fuente de multicolinealidad perfecta aparece cuando se utilizan distintas variables binarias, o ficticias, o dummy, como regresores.

7.3.2. Ejemplo:

7.3.2.1. Supongamos que se han dividido los distritos escolares en tres categorías: rurales, suburbanos y urbanos. Cada distrito se asigna a una (y solo a una) categoría. Sean estas variables binarias la variable Rurali que es igual a 1 para un distrito rural e igual 0 en caso contrario; la variable Suburbanoi ; y la variable Urbanoi . Si se incluyen las tres variables binarias en la regresión, junto con una constante, los regresores presentarán multicolinealidad perfecta: debido a que cada distrito pertenece a una y solo una categoría, Rurali+Suburbanoi+ Urbanoi=1=Xi0, donde X0i representa el regresor constante introducido en la Ecuación

7.4. Soluciones a la multicolinealidad perfecta.

7.4.1. La multicolinealidad perfecta aparece habitualmente cuando se ha cometido un error en la especificación de la regresión. A veces, el error es fácil de detectar (como en el primer ejemplo), pero a veces no lo es (como en el segundo ejemplo). De una forma u otra, el software permitirá saber si se está cometiendo un error debido a que el estimador MCO no se puede calcular.

7.4.2. Cuando el software detecta que existe multicolinealidad perfecta, es importante modificar la regresión para eliminarlo. Algunos programas resultan poco fiables cuando existe multicolinealidad perfecta, y, como mínimo, se cederá el control sobre la elección de los regresores al ordenador si los regresores presentan multicolinealidad prefecta.

7.5. Multicolinealidad imperfecta

7.5.1. La multicolinealidad imperfecta significa que dos o más de los regresores están altamente correlacionados en el sentido de que existe una función lineal de los regresores que se encuentra altamente correlacionada con otro regresor. La multicolinealidad imperfecta no plantea ningún problema para la teoría de los estimadores MCO; de hecho, un propósito de MCO es separar las influencias independientes de los distintos regresores cuando estos regresores están potencialmente correlacionados.

7.5.2. Si los regresores presentan multicolinealidad imperfecta, entonces los coeficientes de al menos un regresor individual se estimarán de forma imprecisa.

8. Definición del sesgo de variable omitida

9. El sesgo de variable omitida y el primer supuesto de mínimos cuadrados

9.1. El sesgo de variable omitida significa que el primer supuesto de mínimos cuadrados, que E(uiXi)=0, no se cumple.

9.1.1. Esto debido a que que el término de error ui en el modelo de regresión lineal con un único regresor representa todos los factores, distintos de Xi , que son determinantes de Yi . Si uno de esos otros factores está correlacionado con Xi , esto significa que el término de error (que contiene a este factor) está correlacionado con Xi

10. Fórmula del sesgo de variable omitida

10.1. Formula:

10.1.1. 1. El Sesgo de variable omitida es un problema tanto si el tamaño de la muestra es grande como si es pequeño. Debido a que b1(estimador) no converge en probabilidad al verdadero valor b1, b1(estimador) es sesgado y es inconsistente; es decir, b1(estimador) no es un estimador consistente de b1 cuando existe sesgo de variable omitida. El término oXu(pu/pX) de la ecuación inicial es el sesgo de b1 (estimador), que persiste incluso en muestras grandes.

10.1.2. 2. Si este sesgo es grande o pequeño, en la práctica depende de la correlación oXu entre el regresor y el término de error. Cuanto mayor sea oXu, mayor sesgo.

10.1.3. 3. La dirección del sesgo de b1 (estimador) depende de si X y u están positiva o negativamente correlacionadas. Por ejemplo, se especuló acerca de si el porcentaje de estudiantes que están aprendiendo inglés tiene un efecto negativo sobre las calificaciones del distrito en el examen (los estudiantes en proceso de aprendizaje del idioma obtienen puntuaciones más bajas), por lo que el porcentaje de estudiantes de inglés entra en el término de error con signo negativo

11. El modelo de regresión múltiple

11.1. El modelo de regresión múltiple extiende el modelo de regresión simple (con regresor único) para incluir variables adicionales como regresores. Este modelo permite estimar el efecto sobre Yi de la variación de una variable (X1i) manteniendo constantes el resto de regresores (X2i, X3i, etc.).

12. La recta de regresión poblacional

12.1. Supongamos por el momento que solo hay dos variables independientes, X1i y X2i. En el modelo de regresión lineal múltiple, la relación promedio entre estas dos variables independientes y la variable dependiente, Y, está dada por la función lineal

12.1.1. Funcion:

13. El modelo de regresión múltiple poblacional

13.1. Fórmula:

13.1.1. En la regresión con regresores binarios, puede ser útil considerar b0 como el coeficiente de un regresor que es siempre igual a 1; piénsese en b0 como el coeficiente de X0i siendo X0i %1 para i= 1, ..., n. Por tanto, el modelo de regresión múltiple poblacional de la ecuación anterior puede escribirse alternativamente como

13.1.1.1. Fórmula:

13.1.1.1.1. Por tanto el modelo de regresión múltiple es:

14. Multicolinealidad

14.1. Multicolinealidad imperfecta

14.1.1. La multicolinealidad imperfecta significa que dos o más de los regresores están altamente correlacionados en el sentido de que existe una función lineal de los regresores que se encuentra altamente correlacionada con otro regresor.

14.2. Multicolinealidad perfecta

14.2.1. Surge cuando uno de los regresores es una combinación lineal perfecta del restos de los regresores.