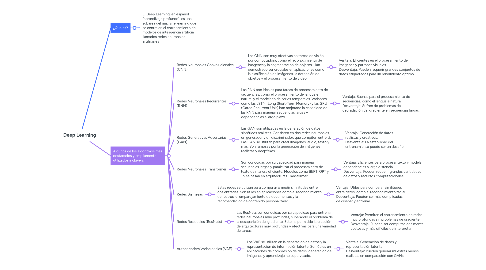

1. ¿Que es?

1.1. El Deep Learning, en español "aprendizaje profundo", es una subárea del machine learning que se centra en el entrenamiento de modelos de inteligencia artificial llamados redes neuronales artificiales

2. Algunos de los algoritmos más destacados y ampliamente utilizados incluyen:

2.1. Redes Neuronales Convolucionales (CNN)

2.1.1. Las CNN son muy efectivas en tareas de visión por computadora, como el reconocimiento de imágenes y la segmentación de objetos. Han demostrado ser cruciales en aplicaciones como la clasificación de imágenes, la detección de objetos y el procesamiento de video.

2.1.1.1. Ventaja: Eficientes en el procesamiento de imágenes y patrones visuales. Desventaja: Pueden requerir grandes conjuntos de datos etiquetados para un rendimiento óptimo.

2.2. Redes Neuronales Recurrentes (RNN)

2.2.1. Las RNN son ideales para tareas de procesamiento de secuencias, como el procesamiento de lenguaje natural y el modelado de series temporales. Variantes como las LSTM (Long Short-Term Memory) y las GRU (Gated Recurrent Unit) han mejorado la capacidad de las RNN para manejar secuencias largas y dependencias a largo plazo.

2.2.1.1. Ventaja: Buenas para el procesamiento de secuencias, como el lenguaje natural. Desventaja: Sufren de problemas de degradación del gradiente en secuencias largas.

2.3. Redes Generativas Adversarias (GAN)

2.3.1. Las GAN son utilizadas en la generación de datos sintéticos realistas. Consisten en dos redes neuronales, un generador y un discriminador, que compiten entre sí. Las GAN se utilizan para crear imágenes, audio, texto y más. Son famosas por la generación de imágenes realistas y deepfakes.

2.3.1.1. Ventaja: Generación de datos realistas y creativos. Desventaja: La estabilidad del entrenamiento puede ser un desafío.

2.4. Redes Neuronales Transformer

2.4.1. Son conocidas por su capacidad para manejar secuencias largas y paralelizar el procesamiento de texto de manera eficiente. Modelos como BERT, GPT y T5 se basan en arquitecturas Transformer.

2.4.1.1. Ventaja: Eficientes para procesar texto y modelar dependencias a larga distancia. Desventaja: Pueden requerir grandes cantidades de datos y recursos computacionales.

2.5. Redes Siamesas

2.5.1. Estas redes se utilizan para comparar o medir similitudes entre dos entradas. Son útiles en aplicaciones como el reconocimiento de rostros, el emparejamiento de documentos y la recomendación de contenido personalizado.

2.5.1.1. Ventaja: Útiles para comparar similitudes entre datos, como el reconocimiento facial. Desventaja: Pueden ser más complicadas de diseñar y entrenar.

2.6. Redes Residuales (ResNets)

2.6.1. Las ResNets son conocidas por su capacidad para entrenar redes neuronales muy profundas, superando el problema de la desaparición del gradiente. Esto ha permitido la creación de arquitecturas muy profundas y efectivas para una variedad de tareas.

2.6.1.1. Ventaja: Permiten el entrenamiento de redes muy profundas sin problemas de gradiente. Desventaja: Pueden ser computacionalmente costosas y más difíciles de interpretar.

2.7. Autoencoders Variacionales (VAE)

2.7.1. Los VAE se utilizan en la generación de datos y la representación de información latente. Son útiles en aplicaciones de compresión de datos, generación de imágenes y aprendizaje no supervisado.

2.7.1.1. Ventaja: Generación de datos y representación latente. Desventaja: Pueden generar muestras menos realistas en comparación con GANs.