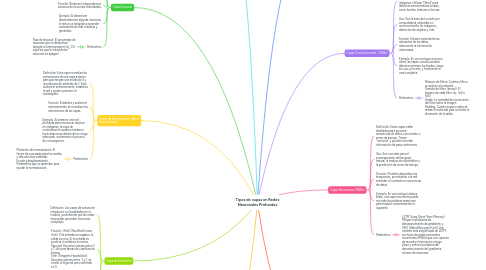

1. Capas Densas:

1.1. Definición: En estas capas, cada neurona está conectada a todas las neuronas de la capa anterior. Esto permite que la red aprenda relaciones muy complejas entre los datos.

1.2. Uso: Son esenciales para la "toma de decisiones" final de la red, como clasificar imágenes o predecir valores.

1.3. Función: Transforman los datos de una forma que permite a la red reconocer patrones globales.

1.4. Ejemplo: Al final de una red que clasifica fotos de animales, una capa densa puede decidir si la imagen es de un perro, un gato o un pájaro.

1.5. Parámetros: ReLU, Sigmoid, Tanh, etc.

2. Capas Convolucionales (CNNs)

2.1. Definición: Estas capas son especialistas en procesar datos con estructura de cuadrícula, como imágenes. Utilizan "filtros" para detectar características locales, como bordes, texturas o formas.

2.2. Uso: Son la base de la visión por computadora, utilizadas en reconocimiento de imágenes, detección de objetos y más.

2.3. Función: Extraen características relevantes de los datos, reduciendo la información innecesaria.

2.4. Ejemplo: En una red que reconoce caras, las capas convolucionales detectan primero los bordes, luego los ojos y la nariz, y finalmente la cara completa.

2.5. Parámetros

2.5.1. Número de filtros: Cuántos filtros se aplican a la entrada. Tamaño del filtro (kernel): El tamaño de cada filtro (ej., 3x3 o 5x5). Stride: La cantidad de movimiento del filtro sobre la imagen. Padding: Cuánto espacio extra se añade a la entrada para controlar la dimensión de la salida.

3. Capas Recurrentes (RNNs)

3.1. Definición: Estas capas están diseñadas para procesar secuencias de datos, como texto o series de tiempo. Tienen "memoria" y pueden recordar información de pasos anteriores.

3.2. Uso: Son cruciales para el procesamiento del lenguaje natural, la traducción automática y la predicción de series de tiempo.

3.3. Función: Modelan dependencias temporales, permitiendo a la red entender el contexto en secuencias de datos.

3.4. Ejemplo: En una red que traduce texto, una capa recurrente puede recordar las palabras anteriores para traducir correctamente la siguiente.

3.5. Parámetros

3.5.1. LSTM (Long Short-Term Memory) Mitigan el problema de desvanecimiento de gradiente. y GRU (Gated Recurrent Unit) Una variante más simplificada de LSTM. son tipos de redes neuronales recurrentes (RNNs) que son capaces de recordar información a largo plazo y evitar el problema del desvanecimiento del gradiente, número de neuronas.

4. Capas de Agrupación (Pooling)

4.1. Definición: Estas capas reducen el tamaño de los datos, conservando la información más importante. Esto reduce la carga computacional y ayuda a la red a generalizar mejor.

4.2. Uso: Se utilizan comúnmente en redes convolucionales para reducir la dimensionalidad de las imágenes.

4.3. Función: Simplifican la información, haciendo que la red sea más eficiente y robusta.

4.4. Ejemplo: Después de que una capa convolucional detecta bordes en una imagen, una capa de pooling puede reducir la resolución de la imagen, manteniendo solo los bordes más destacados.

4.5. Parámetros: Tamaño del filtro de pooling.

4.5.1. Tamaño de la ventana: El tamaño del área sobre la que se realiza el pooling (ej., 2x2). Stride: Cuánto se mueve la ventana sobre la imagen.

5. Capas de Normalización

5.1. Definición: Estas capas ayudan a estabilizar el entrenamiento de la red, asegurando que las activaciones de las neuronas tengan una distribución adecuada

5.2. Uso: Se utilizan para acelerar el entrenamiento y mejorar el rendimiento de la red.

5.3. Función: Hacen que el entrenamiento sea más estable y eficiente.

5.4. Ejemplo: La normalización por lotes ajusta las activaciones de cada capa para que tengan una media y varianza consistentes.

6. Capas Dropout

6.1. Definición: Estas capas son una técnica de regularización que ayuda a prevenir el sobreajuste. Durante el entrenamiento, desactivan aleatoriamente algunas neuronas.

6.2. Uso: Se utilizan para mejorar la capacidad de generalización de la red.

6.3. Función: Reducen la dependencia excesiva de neuronas individuales.

6.4. Ejemplo: Al desactivar aleatoriamente algunas neuronas, la red se ve obligada a aprender características más robustas y generales.

6.5. Parámetros

6.5.1. Tasa de dropout: El porcentaje de neuronas que se desactivan durante el entrenamiento (ej., 0.5 significa que la mitad de las neuronas se apagan).

7. Capa de Activación

7.1. Definición: Las capas de activación introducen no linealidades en el modelo, permitiendo que las redes neuronales aprendan funciones complejas

7.2. Función: ReLU (Rectified Linear Unit): Si la entrada es negativa, la salida es cero. Si la entrada es positiva, la salida es la misma. Sigmoid: Devuelve valores entre 0 y 1, útil para tareas de clasificación binaria. Tanh (Tangente Hiperbólica): Devuelve valores entre -1 y 1, es similar al Sigmoid pero centrado en 0.

7.3. Ejemplo: en la construcción de una red neuronal para clasificación binaria (por ejemplo, detectar si una imagen es un gato o un perro), la función Sigmoid en la capa de salida permite generar una probabilidad de que la imagen pertenezca a la clase "gato".

7.4. Parámetros: No requieren parámetros adicionales.

8. Capas de Normalización (Batch Normalization)

8.1. Definición: Esta capa normaliza las activaciones de una capa anterior para que tengan una media de 0 y una desviación estándar de 1. Esto acelera el entrenamiento, estabiliza la red y ayuda a prevenir el sobreajuste.

8.2. Función: Estabiliza y acelera el entrenamiento al normalizar las activaciones de las capas.

8.3. Ejemplo: Al entrenar una red profunda para reconocer objetos en imágenes, la capa de normalización ayuda a mantener las activaciones dentro de un rango adecuado, acelerando el proceso de convergencia.

8.4. Parámetros

8.4.1. Momento de normalización: El factor de suavizado para las medias y desviaciones estándar. Escala y desplazamiento: Parámetros que se aprenden para ajustar la normalización.

9. Capa de Salida

9.1. Definición: Esta capa produce la salida final de la red neuronal, ya sea una predicción continua en tareas de regresión o una probabilidad para cada clase en tareas de clasificación.

9.2. Ejemplo: Si se clasifican imágenes de dígitos escritos a mano (MNIST), la capa de salida tendrá 10 neuronas (una por cada dígito) y una función de activación softmax para convertir las salidas en probabilidades de cada clase.

9.3. Parámetros

9.3.1. Número de neuronas: Depende del número de clases (para clasificación multiclase). Función de activación: Softmax (multiclase), Sigmoid (binaria).